Ahogy haladunk előre az időben úgy tűnik, egyre inkább távolodunk a valóságtól, ebben pedig a meghamisított képeknek is nagy szerepe van, ám a valóságtól mentes jövő felé vezető úton legalább jól szórakozhatunk.

A Samsung AI Center és a moszkvai Skolkovo Institute of Science and Technology kutatói közzétettek egy olyan videót, amiben elmagyarázzák, hogyan alkottak neurális hálózatokat, olyan céllal, hogy álló portrékból élethű videókat készítsenek. Ezek az alkotások a „talking head models” nevet kapták. Egyik esetben például Leonardo da Vinci híres Mona Lisája vált egy lélegző, mozgó emberré. Lenyűgöző figyelni, ahogy a világ egyik leghíresebb mozdulatlan alkotása életre kel, különösen, ha figyelembe vesszük a festmény sokat vitatott és rejtélyes múltját. Az átalakítás után a Mona Lisa mosolya kifejezetten valóságosnak hat. Ám abba is félelmetes belegondolni, hogy milyen gyorsan fejlődik a mesterséges intelligencia (AI) által végzett képalkotás és ez milyen hatással lesz a médiára nézve.

Az elmúlt három évben az AI algoritmusok által készített tartalmak széles palettájával találkozhattunk a vicces videóktól az egészen durvákig: Nicholas Cage átvette más színészek helyét egyes filmekben, Barack Obama saját mimikájával, ám Jordan Peele hangjával beszélt egy videóban, valamint megjelent egy új Reddit trend: hírességek arcát illesztették pornószínésznőkére, és egyre élethűbb ál-celebpornókat tettek közzé. Ami az álló képeket illeti, az Nvidia keményen dolgozott, hogy létrehozzon élethű generált képeket emberekről.

Amióta a Reddit felhasználók elkezdték gyártani a deepfake videókat egyes emberekről 2017-ben, egyre inkább megfogalmazódhat bennünk a kérdés, hogy vajon hihetünk-e a továbbiakban a saját szemünknek. A megoldást ezzel a mesterséges valósággal kapcsolatban azoktól a vállalatoktól várhatjuk, akik a mesterséges intelligencia kutatásba nagy pénzeket pumpálnak. Digitálisan manipulált videók már korábban is készültek, az új jelenség abban különbözik, hogy itt az érdemi munkát nem a felhasználó végzi, hanem a mesterséges intelligencia. Az AI alapú videomanipuláció jelensége a reddites fórumok nyomán deepfake nevet kapta, ami a deep learning (mély tanulás) és a fake (ál-, hamis) szavakból tevődik össze.

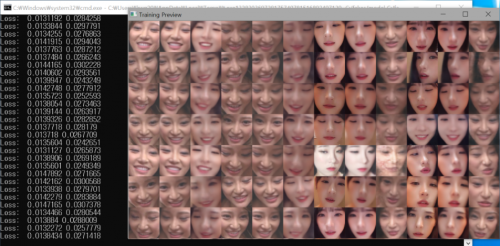

A Moszkvában készült neurális hálózatok végtelennek tűnően sok képet elemeznek és az adott ember adott képen lévő mimikáját felhasználva rengeteg álló képből egy videót alkotnak. Ez az eljárás akár egy képpel is végrehajtható, mint például a Mona Lisa, ám a végeredményként kapott életre kelt alak korlátozva lesz a mozgási lehetőségeiben és az érzelmei kimutatásában, mivel az alapanyag csupán egy kép volt. Azonban ha az a cél, hogy egy új videót hozzunk létre egy valós személyről és az algoritmus az eredeti felvétel több részletét is fel tudja dolgozni, az eredmény egy sokkal hihetőbb deepfake videó lesz.

Ahhoz, hogy ilyen meggyőző hatást egyetlen egy képpel érjük el, még kicsit várnunk kell. Több kép esetén viszont a neurális hálózatoknak hatalmas adatforrás áll rendelkezésére, így a folyamat során elemzik az adott emberek valós képeit, egységes szerkezetbe foglalják ezeket és ezeket felhasználva továbbiakat gyártanak, így hihető videó készíthető. Ha úgy látjuk, hogy az a videó, amelynek az alapanyaga csupán egy kép volt – mint a Mona Lisa esetében – nem olyan hiteles, mint az, amelyiket több kép felhasználásával hoztak létre, megnyugodhatunk, a folyamat rövidesen kiforrottabbá válik, így aggodalomra semmi ok.

Vagy mégis?

Pár éve az, hogy az emberek ilyen dolgokra képesek, sci-fi filmekbe illő téma lett volna, ám a helyzet az, hogy ma már nem kell ilyen műfajú könyveket olvasnunk, vagy filmeket néznünk, hogy ezzel szembesüljünk. Ahogy a mesterséges intelligencia fejlődik, egyre nagyobb a felelősségünk olyan téren, hogy mit hiszünk el. Főleg akkor, amikor a hírekként bemutatott képek hitelessége drámaian megkérdőjelezhetővé válik. Ám a művészetekben és a vizuális kultúrában a mesterséges intelligencia rendkívül érdekes lehetőségeket teremt. Ha csak azt vesszük, hogy ha a világ híres festményei és fotói egyszer csak beszélni kezdenek, az már magában mennyire menő.

Mint minden új technológia, természetesen ez is használható jó célokra de egyaránt alkalmas tömegmanipulációra és kicsinyes bosszúkra. A deepfake olyannyira megállíthatatlannak tűnik, hogy az álhírek és a poszt-igazság (post-truth, a 2016-os év szava az Oxford Dictionaries-nél) talán az általunk értelmezett valóság végét jelentheti majd. Jelenleg a probléma részleges kezelése zajlik csupán, ám hosszú távon ennyi nem lesz elég, főleg, hogy csak idő kérdése, mikor jelenik meg a politikában, mint hatalmi célok elérésére használt eszköz. Aviv Ovadya egyenesen a demokráciát félti a deepfaketől. A Thoughtful Technology Project alapítója elmondta, hogy ha egy gépi tanulásos algoritmus több száz órányi felvételt elemez Donald Trumpról vagy Kim Dzsongunról, akkor szinte bármilyen szöveg adható ezen politikusok szájába közel tökéletesen hihető videó vagy hangfelvétel formájában, például arról, hogy valamelyik vezető kikiáltja a nukleáris háborút. Aviv Ovadya így fogalmazott: „nem is kell tökéletesnek lenniük, csak elég jónak ahhoz, hogy az ellenség elhiggye, hogy tényleg megtörtént, és ez hirtelen felindulásból tett megtorló akciót válthat ki”.

Ezek az aggasztó előjelek két következménnyel járhatnak. Egyrészt az embereknek elege lesz abból, hogy minden felületen ál-hírekkel, manipulált üzenetekkel, tartalmakkal kell találkozniuk. Következésképpen előfordulhat, hogy megrendül az embereknek a digitális eszközökön keresztül elért eddig hitelesnek vélt hírforrásokba vetett reménye, így hátat fordítanak ezen platformoknak. Így azonban a demokrácia fenntartásához szükséges általános tájékozottságra szinte esély sincs a 21. században. Nehezítő tényező, hogy a tévében és a Youtube-on az emberek már találkoztak a mozgóképek manipulációjával és már kiismerhették, hogy egy jól megvágott videó adott esetben mennyire félrevezető lehet, ám a vágatlan videók, felvételek, hangfelvételek hitelességéhez napjainkig nem fért kétség, ám úgy tűnik ez lassan már a múlté.

A másik jelentős negatív következménnyel kapcsolatban Renee DiResta fejezte ki aggályait. A dezinformációs szakértő rámutatott, hogy annak a ténye, hogy ilyen technológia létezik, már önmagában veszélyes lehet minden hír hitelességére nézve még akkor is, ha nem jelennek meg tömegével a hamisított videók. A szakértő így fogalmazott: „Nem kell konkrétan elkészíteni a hamisított videót, hogy a technikának komoly hatása legyen. Csak rá kell mutatni, hogy létezik ilyen, és máris kétségbe vonható a valódi dolgok integritása.”

Orosz trollok már Amerika-ellenes videókat gyártanak, az USA és az EU egyenlőre védekezik.

Megkezdődött az emberek tájékoztatása is a mesterséges intelligencia által gyártott álvideók veszélyeiről. Jordan Peele videójában szándékosan adtak olyan szöveget Obama szájába, amit nyilvánvalóan soha nem mondana ki, így ez egyfajta társadalmi célú hirdetés volt, ami a deepfake politikai veszélyeire hívta fel a figyelmet.

A deepfake legnagyobb veszélye tisztán látható: azt az eddig megkérdőjelezhetetlen állítást rúgja fel, hogy ha másnak nem is, legalább a saját szemünknek hihetünk. Ezzel szemben ez a technológia új alkotási folyamatokat nyit meg számunkra, melyek a kreatív alkotásra nézve kifejezetten pozitív hatással vannak. Az egyik oldalon a beszélő Mona Lisa, a másikon egy lehetséges atomháború, a döntés pedig az emberiség kezében van.

(Qubit)

Figyelem! A tartalom legalább 2 éve nem frissült! Előfordulhat, hogy a képek nem megfelelően jelennek meg.